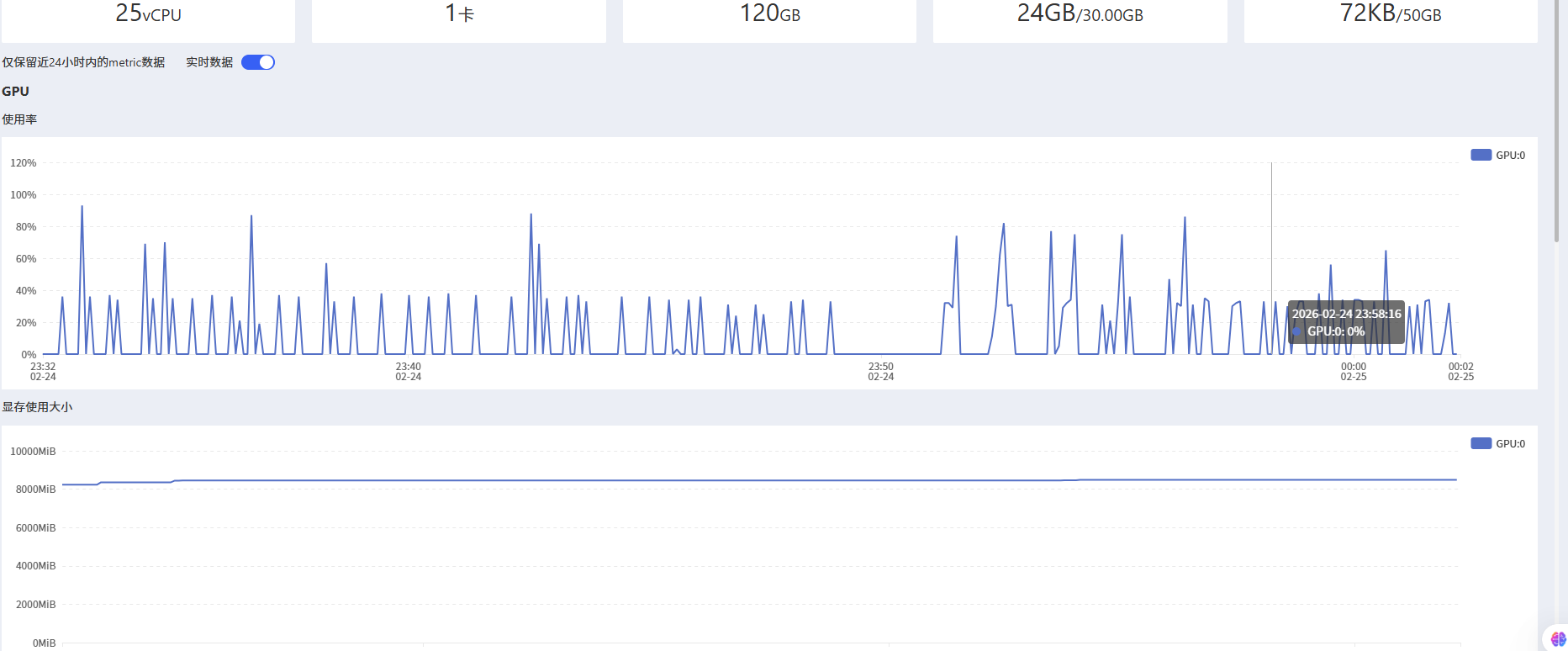

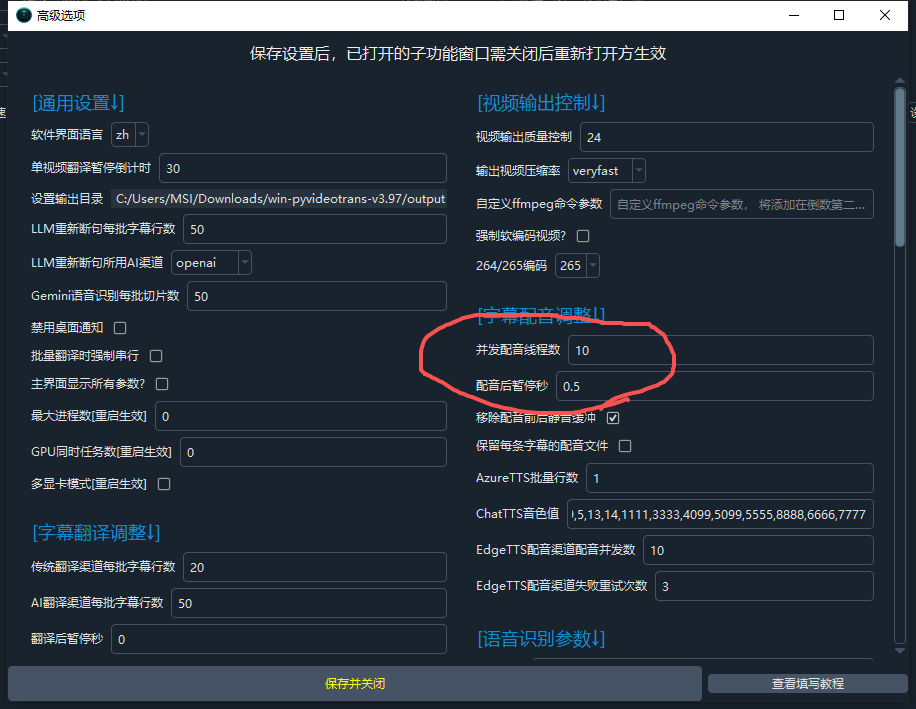

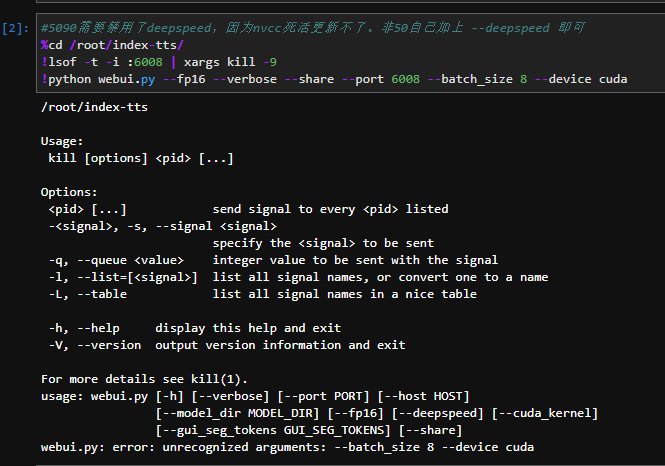

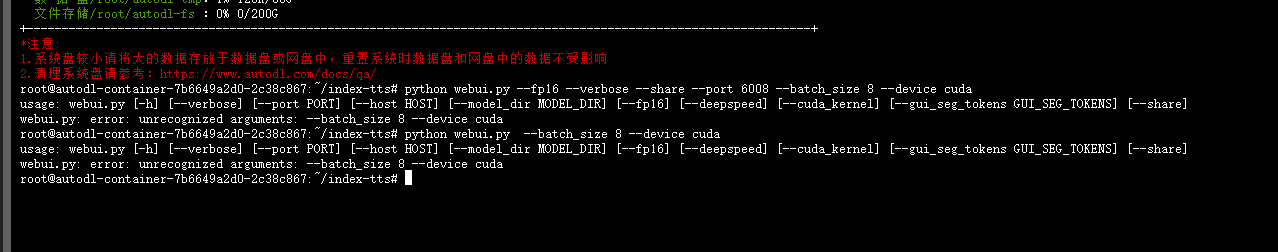

我是5090显卡感觉显卡性能都没有用到多少,怎么设置变的更快一点

#3350 使用index-tts2配音速度太慢了

2409:896a*

Posted at: 3 months ago

7 Replies

Post Your Reply

Open source and free maintenance is not easy. If this project is helpful to you, please consider making a small donation to help the project continue to maintain and update.

Dondate: ko-fi.com/jianchang512