系统错误 (None):None:

concurrent.futures.process._RemoteTraceback:

"""

Traceback (most recent call last):

File "concurrent\futures\process.py", line 246, in _process_worker

File "videotrans\process\tts_fun.py", line 63, in qwen3tts_fun

File "D:\pyVideoTrans\_internal\qwen_tts\inference\qwen3_tts_model.py", line 112, in from_pretrained

model = AutoModel.from_pretrained(pretrained_model_name_or_path, **kwargs)File "transformers\models\auto\auto_factory.py", line 604, in from_pretrained

return model_class.from_pretrained(File "D:\pyVideoTrans\_internal\qwen_tts\core\models\modeling_qwen3_tts.py", line 1876, in from_pretrained

model = super().from_pretrained(File "transformers\modeling_utils.py", line 277, in _wrapper

return func(*args, **kwargs)File "transformers\modeling_utils.py", line 4900, in from_pretrained

checkpoint_files, sharded_metadata = _get_resolved_checkpoint_files(File "transformers\modeling_utils.py", line 989, in _get_resolved_checkpoint_files

raise OSError(OSError: Error no file named pytorch_model.bin, model.safetensors, tf_model.h5, model.ckpt.index or flax_model.msgpack found in directory D:/pyVideoTrans/models/models--Qwen--Qwen3-TTS-12Hz-1.7B-CustomVoice.

"""

The above exception was the direct cause of the following exception:

Traceback (most recent call last):

File "videotrans\util\ListenVoice.py", line 16, in run

File "videotrans\tts\__init__.py", line 346, in run

File "videotrans\tts\_base.py", line 136, in run

File "videotrans\tts\_qwenttslocal.py", line 53, in _exec

File "videotrans\configure\_base.py", line 284, in _new_process

File "concurrent\futures\_base.py", line 458, in result

File "concurrent\futures\_base.py", line 403, in __get_result

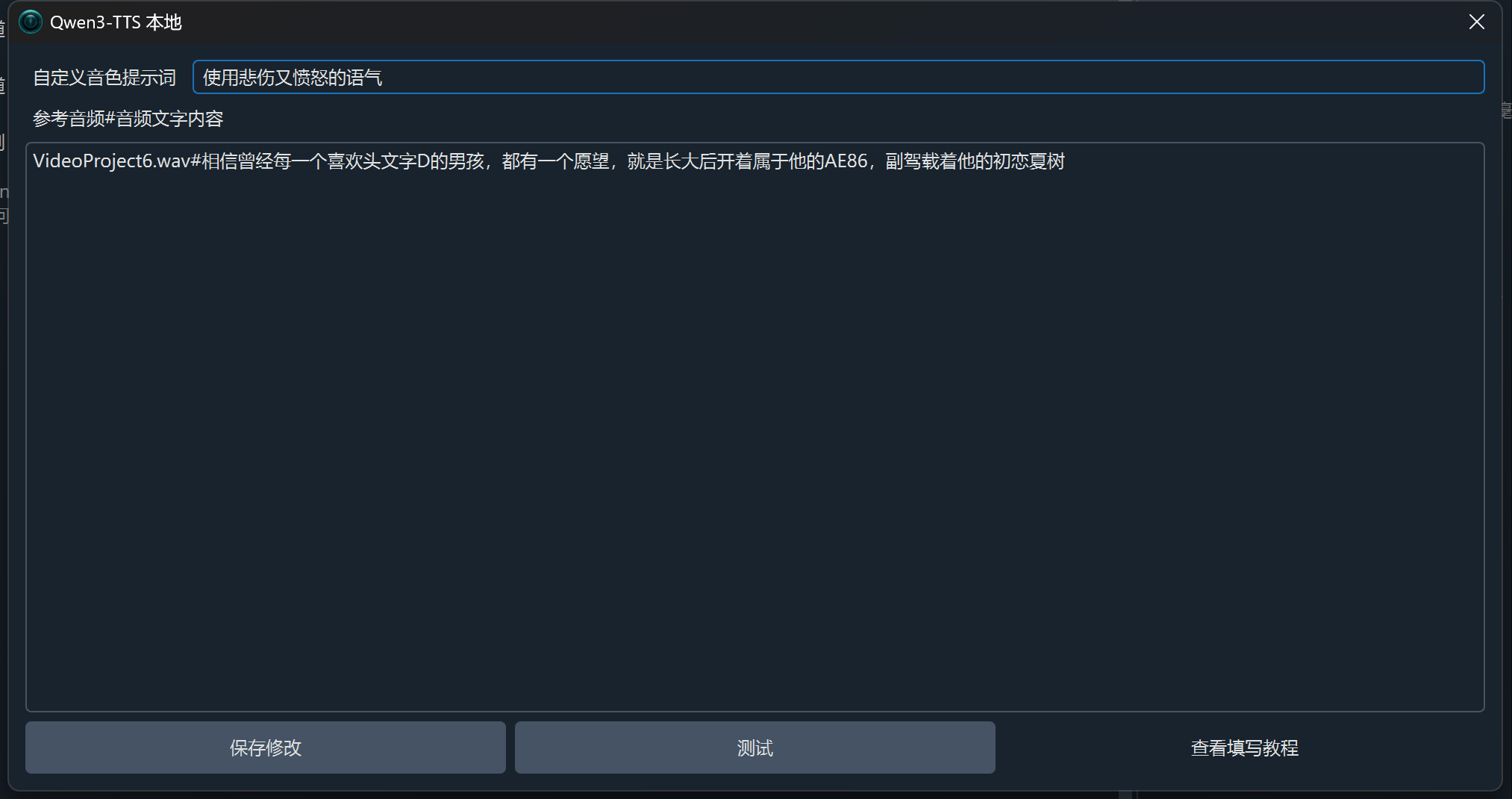

OSError: Error no file named pytorch_model.bin, model.safetensors, tf_model.h5, model.ckpt.index or flax_model.msgpack found in directory D:/pyVideoTrans/models/models--Qwen--Qwen3-TTS-12Hz-1.7B-CustomVoice.

=

system:Windows-10-10.0.26200-SP0

version:v3.97

frozen:True

language:zh

root_dir:D:/pyVideoTrans