2026-04-18 16:25:09,249 - modelscope - WARNING - We can not confirm the cached file is for revision: master

[DEBUG] 开始说话人分离:使用阿里cam++模型

[DEBUG] 说话人分离原始返回结果:result={'text': [[3.35, 4.62, 0], [5.74, 6.79, 0], [12.15, 13.45, 0], [13.92, 16.22, 0], [17.24, 17.77, 0], [20.63, 21.27, 1], [21.92, 22.52, 1], [23.87, 24.67, 2], [25.56, 26.93, 2], [28.7, 30.04, 2], [30.46, 39.23, 2], [39.51, 44.26, 2], [44.54, 47.38, 2], [47.66, 52.5, 2], [53.56, 56.27, 3], [58.45, 60.53, 3], [62.05, 65.68, 3], [66.94, 68.18, 3], [69.92, 72.08, 3], [73.22, 78.55, 3], [78.83, 81.0, 3], [81.83, 83.31, 3], [83.59, 89.69, 3], [90.08, 91.57, 3], [92.31, 94.64, 3], [95.32, 97.03, 2], [99.62, 100.56, 2], [104.07, 107.59, 2], [108.07, 109.11, 2], [109.39, 111.21, 2], [111.49, 113.28, 2], [113.28, 115.15, 0], [115.15, 116.6, 2], [119.59, 121.7, 2], [122.0, 124.31, 2], [127.96, 128.57, 0], [129.21, 134.32, 0], [149.19, 150.16, 4], [151.28, 155.97, 4], [156.93, 161.33, 4], [161.33, 162.87, 2], [163.27, 165.2, 2], [166.21, 167.44, 2], [167.95, 170.17, 2], [170.75, 171.69, 2], [171.97, 173.35, 2], [173.67, 183.56, 2]]}

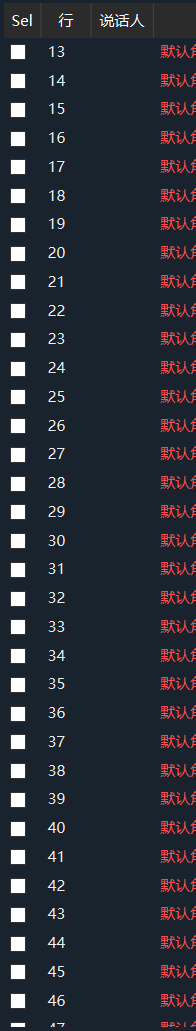

[DEBUG] 说话人分离成功结束,识别出个 0 说话人,耗时:24s

self.trans_thread=10,self.aisendsrt=False,self.translate_type=1

[DEBUG] 以普通文本行按行翻译:原始行数:74,翻译后行数:74

[DEBUG] [字幕翻译]渠道1,:共耗时:0s