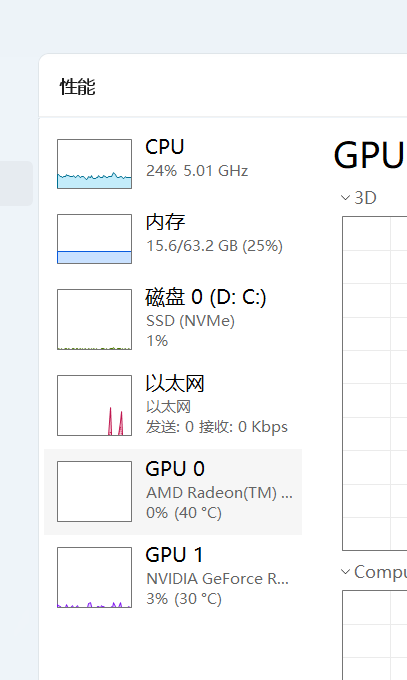

问题1:人声分离部分,不调用我的英伟达独立GPU(16gb显存)加速。速度非常慢。

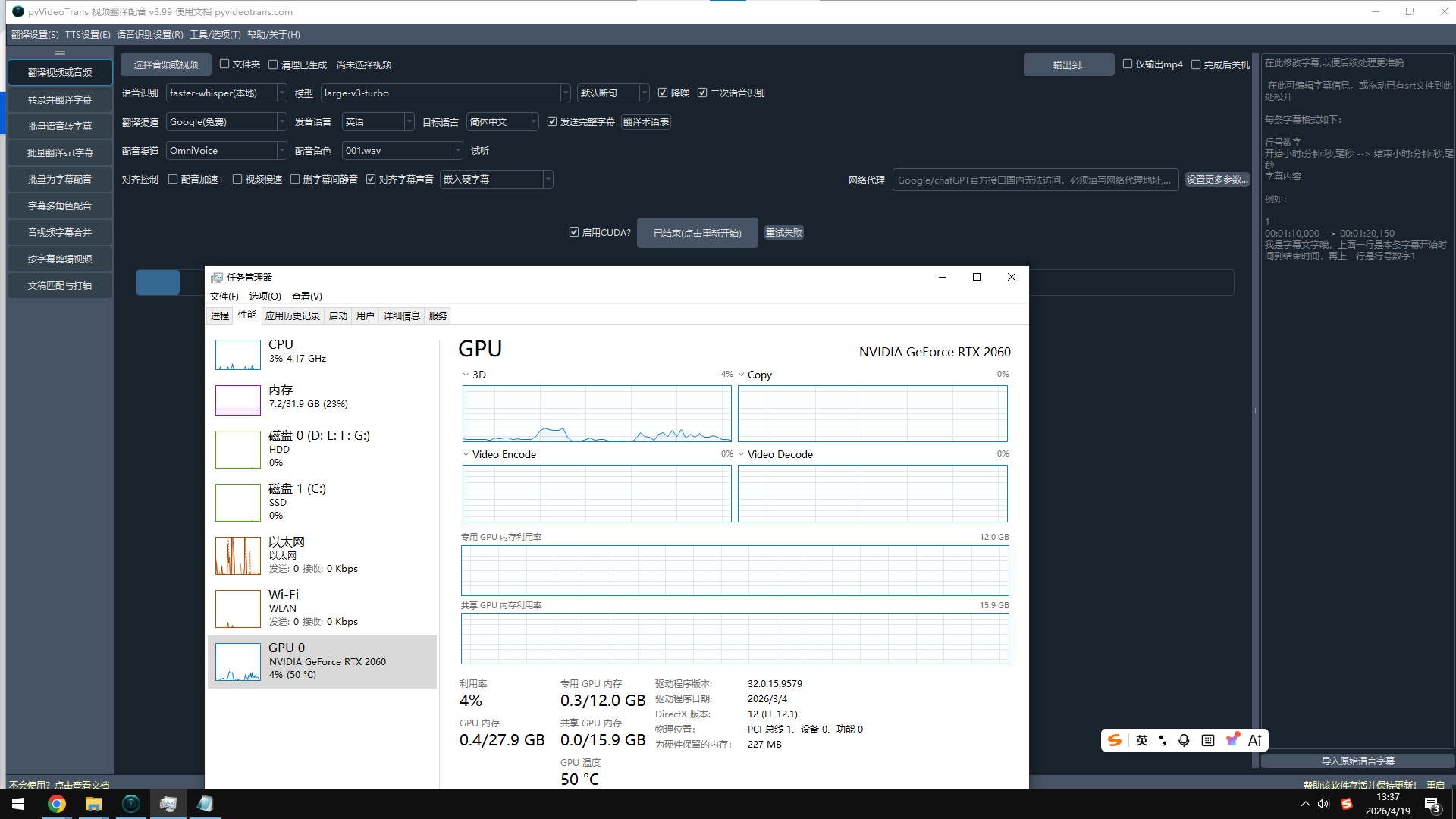

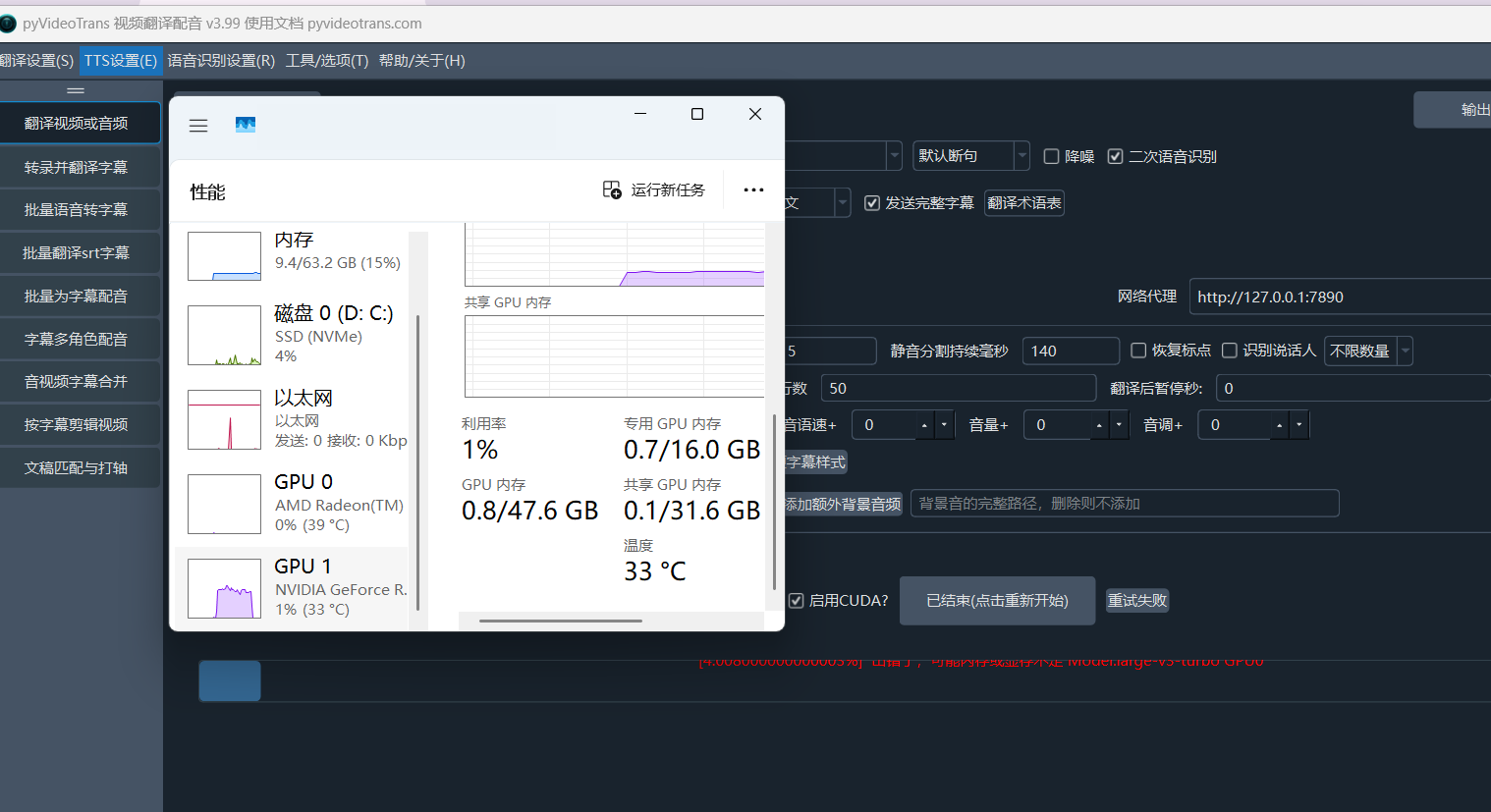

问题2:人声分离后的部分,一开始调用独立GPU进行加速,GPU使用率到40%~50%,然后突然GPU使用率掉到底,软件报错。

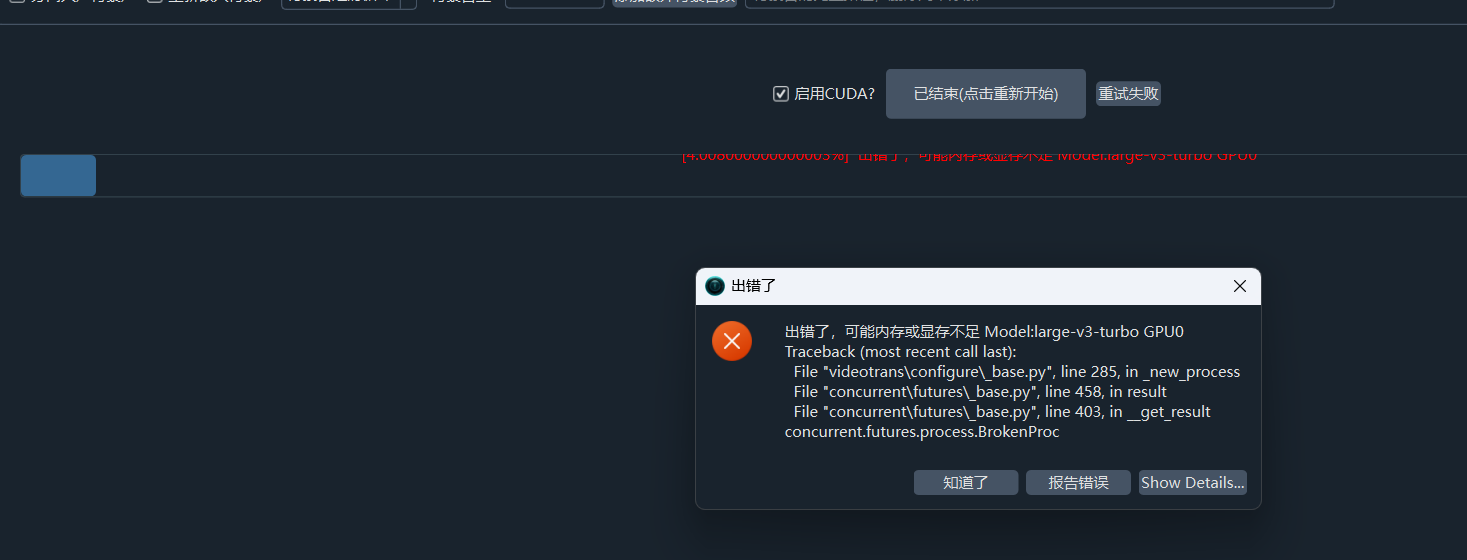

报错截图如下:

报错日志如下:

出错了,可能内存或显存不足 Model:large-v3-turbo GPU0

Traceback (most recent call last):

File "videotrans\configure\_base.py", line 285, in _new_process

File "concurrent\futures\_base.py", line 458, in result

File "concurrent\futures\_base.py", line 403, in __get_result

concurrent.futures.process.BrokenProcessPool: A process in the process pool was terminated abruptly while the future was running or pending.

Traceback (most recent call last):

File "videotrans\configure\_base.py", line 285, in _new_process

File "concurrent\futures\_base.py", line 458, in result

File "concurrent\futures\_base.py", line 403, in __get_result

concurrent.futures.process.BrokenProcessPool: A process in the process pool was terminated abruptly while the future was running or pending.

During handling of the above exception, another exception occurred:

Traceback (most recent call last):

File "videotrans\task\_only_one.py", line 44, in run

File "videotrans\task\trans_create.py", line 361, in recogn

File "videotrans\recognition\__init__.py", line 293, in run

File "videotrans\recognition\_base.py", line 143, in run

File "videotrans\recognition\_overall.py", line 33, in _exec

File "videotrans\recognition\_overall.py", line 105, in _faster

File "videotrans\configure\_base.py", line 303, in _new_process

RuntimeError: 出错了,可能内存或显存不足 Model:large-v3-turbo GPU0

Traceback (most recent call last):

File "videotrans\configure\_base.py", line 285, in _new_process

File "concurrent\futures\_base.py", line 458, in result

File "concurrent\futures\_base.py", line 403, in __get_result

concurrent.futures.process.BrokenProcessPool: A process in the process pool was terminated abruptly while the future was running or pending.