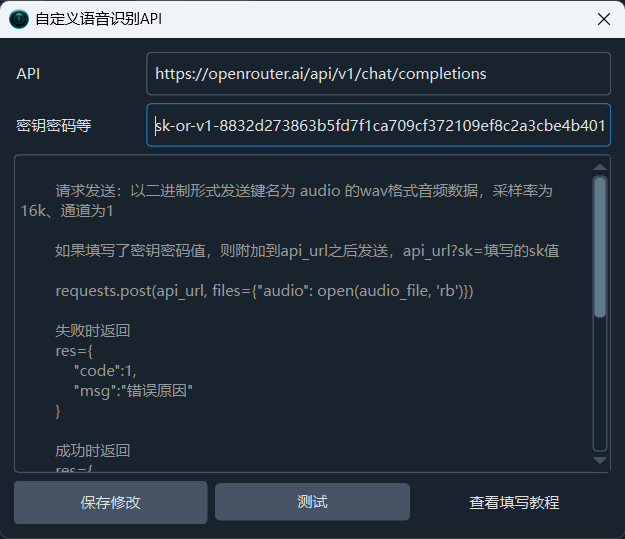

401 Client Error: Unauthorized for url: https://openrouter.ai/api/v1/chat/completions?sk=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:

Traceback (most recent call last):

File "videotrans\recognition\_base.py", line 140, in run

File "tenacity\__init__.py", line 338, in wrapped_f

File "tenacity\__init__.py", line 477, in call

File "tenacity\__init__.py", line 378, in iter

File "tenacity\__init__.py", line 421, in exc_check

tenacity.RetryError: RetryError[]

During handling of the above exception, another exception occurred:

Traceback (most recent call last):

File "videotrans\util\TestSTT.py", line 17, in run

File "videotrans\recognition\__init__.py", line 236, in run

File "videotrans\recognition\_base.py", line 171, in run

File "tenacity\__init__.py", line 480, in call

File "videotrans\recognition\_recognapi.py", line 84, in _exec

File "requests\models.py", line 1026, in raise_for_status

requests.exceptions.HTTPError: 401 Client Error: Unauthorized for url: https://openrouter.ai/api/v1/chat/completions?sk=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

=

system:Windows-10-10.0.26200-SP0

version:v3.95

frozen:True

language:zh

root_dir:C:/py